Видео с ютуба Multi Head Self Attention

Погружение в многоголовое внимание, внутреннее внимание и перекрестное внимание

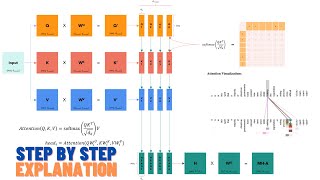

Visual Guide to Transformer Neural Networks - (Episode 2) Multi-Head & Self-Attention

Внутреннее внимание против многоголового внутреннего внимания

Attention in transformers, step-by-step | Deep Learning Chapter 6

The Multi-head Attention Mechanism Explained!

Attention mechanism: Overview

Что такое многоголовое внимание в нейронных сетях-трансформерах?

How Attention Mechanism Works in Transformer Architecture

Трансформаторы зрения #машинноеобучение #наукаоданных #компьютерноезрение

Multi Head Self Attention

Внимание — это всё, что вам нужно (Transformer) — объяснение модели (включая математику), вывод и...

Visualize the Transformers Multi-Head Attention in Action

Introduction to Multi head attention

Multi-Head Attention Visually Explained

Visualizing transformers and attention | Talk for TNG Big Tech Day '24

Multi Head Self Attention (Natural Language Processing at UT Austin)

Трансформеры и самовосприятие (DL 19)

Attention for Neural Networks, Clearly Explained!!!

Transformers and multi-head self-attention || Nikolas Adaloglou || Deep learning WS2023-24